全球首个具备模拟推理能力的具身模型来了!

谷歌DeepMind正式发布新一代通用机器人基座模型——Gemini Robotics 1.5系列。

它不止于对语言、图像进行理解,还结合了视觉、语言与动作(VLA),并通过具身推理(Embodied Reasoning)来实现“先思考,再行动”。

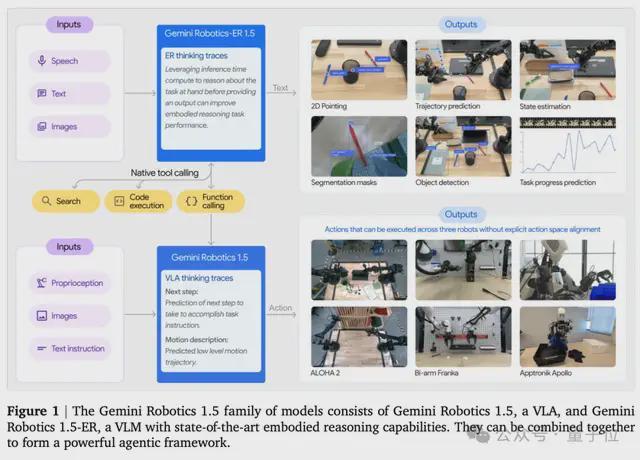

这一系列由两大模型组成:

- Gemini Robotics 1.5(GR 1.5):负责动作执行的多模态大模型;

- Gemini Robotics-ER 1.5(GR-ER 1.5):强化推理能力,提供规划与理解支持。

其中,ER代表“具身推理”。

这意味着GR-ER 1.5是全球首个具备模拟推理能力的具身模型。

不过,GR-ER 1.5并不执行任何实际操作,GR 1.5正是为执行层而生。

两者结合,能让机器人不仅完成“折纸、解袋子”这样的单一动作,还能解决“分拣深浅色衣物”甚至“根据某地天气自动打包行李”这种需要理解外部信息、分解复杂流程的多步任务。

甚至,它能根据特定地点的特定要求(比如北京和上海的不同垃圾分类标准),自己上网搜索,以帮助人们完成垃圾分类。

而且用上GR 1.5系列的模型,还能够在多种不同的机器人之间进行能力的零样本跨平台迁移。

Unbelivable~

毫不夸张地说,这是谷歌继Gemini 2.5之后,又一个将通用AI推向现实世界的重要里程碑。

哈斯比斯也激动表示:

- GR 1.5以多模态Gemini为基础,展示了其能够理解并推理物理世界的强大功能。

未来机器人将变得至关重要——我们对这项开创性工作感到非常兴奋!

GR 1.5系列五大能力展示

先来看一段视频——

我们来把GR 1.5系列在发布中展示的能力,总结为五个关键词:

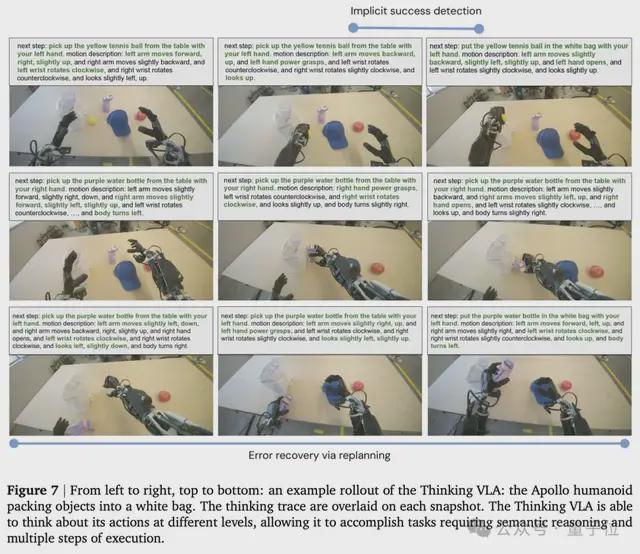

执行复杂长程任务,中间还能自我检测并修正

不仅限于一次抓取、一次搬运,GR 1.5能执行包含多步子任务的长流程。

比如:

- 把不同颜色的衣服分类;

- 从衣柜取出雨衣,再打包进行李箱;

- 在厨房完成配料准备,甚至尝试烹饪流程。

在GR 1.5这里,任务被分解成多个阶段,机器人逐一完成。